現在の噂によると、Appleは現在、Siriの再編成に取り組んでいます。

音声アシスタントは大声でなければなりませんバージより自然でインタラクティブな人工知能を使用してブルームバーグのレポートを参照し、全体的にはるかに強力になります。

Appleの音声アシスタントSiriは、2011年にiPhone 4Sと一緒に紹介され、それ以来メーカーのコスモスの不可欠な部分です。

13年間でSiriは発展しましたが、ChatGptまたはGoogle Geminiからの人工知能の出現とのつながりを失いました。

と»Apple Intelligence«メーカーが先導しましたiOS 18新しいAIツール(現在EUでは利用できません)。ただし、これらの作品は大部分がSiriとは独立しています。

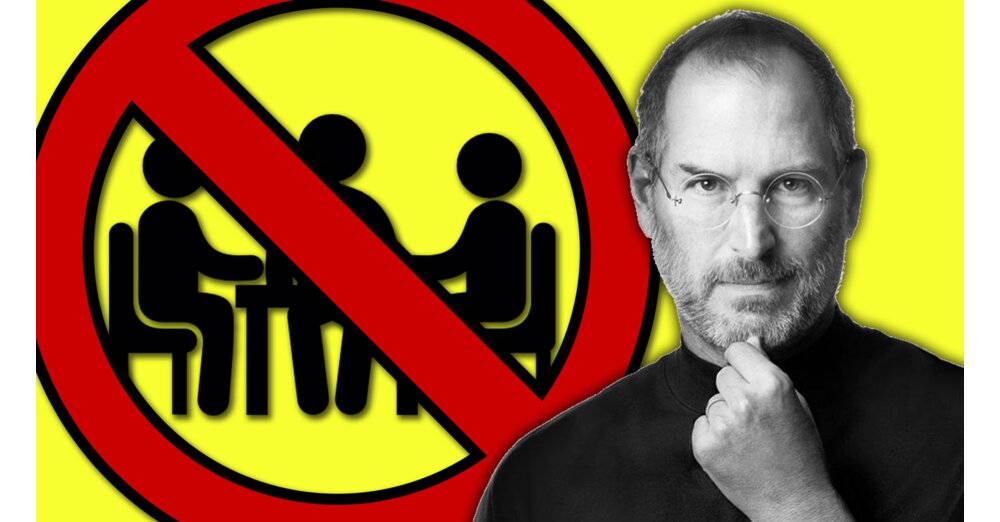

»siri llm«

内部的には、SIRIプロジェクトは「LLM Siri」と呼ばれ、「LLM」は「大規模な言語モデル」を表します。

これは、より複雑なタスクを実行し、コンテキストを理解できるようにすることを目的としています。さらに、サードパーティアプリとの対話が可能です。

さらに、新しいSiriは「Apple Intelligence」に密接にリンクし、テキストなどのタスクを作成または要約することができます。

おそらく今後のWWDCでのプレゼンテーション

Appleは現在、新しいテクノロジーを別のアプリとしてテストしていますが、既存のSIRIを段階的に新しい音声アシスタントに置き換えることを計画しています。

Appleは、来年にiOS 19およびMacOS 16とともに新しいSiriバージョンを提示することができます。

したがって、プレゼンテーションがWorld Wide Developer Conference(WWDC)で行われていると仮定することは合理的です。これは通常6月に行われます。

ただし、最終出版物まで時間がかかるはずです。 2026年春がターゲットになっています。

iOS 18ですでに最初の改善

それとは別に、SiriはiOS 18の下ですでに「よりインテリジェント」である必要があります。今後の更新の1つでは、Appleは最初の独自の音声モデルへのアクセスを導入する必要があります。

とりわけ、Siriはコンテキストでより複雑な問い合わせとコマンドを処理できるはずです。

日常生活でsiriを使用していますか?特にChatGPTのような現在のAIモデルと比較して、音声アシスタントについてどう思いますか?コメントでご意見をお聞かせください。